Name

Soundslike 2.0 – Automatische Annotationen & Empfehlungen für Musik

Funktionsweise

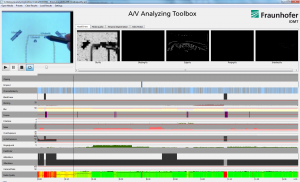

Das Fraunhofer IDMT als Pionier im Bereich MIR (Music Information Retrieval) beschäftigt sich seit seiner Gründung mit der automatischen Extraktion von musikalischen Eigenschaften. Diese werden aus den gewonnenen akustischen und physikalischen Features der Musik in verständliche und allgemein gültige Beschreibungen übersetzt, die als zusätzliche Metadaten in Archiven und Musiksammlungen eingetragen werden können.

Dazu zählen u. a.: Style, Genre, Emotion, Valence, Arousal, Mood, MusicColor, MusicTexture, Tempo, Distortion, Dynamic, Percussive, Synthetic, Instrument.

Für die visuelle Unterstützung beim Auffinden der richtigen, passenden Songs oder Teilen von Werken können die Dateien automatisch segmentiert werden, z.B. in Strophe und Refrain.

Als Ergebnis wird eine Ähnlichkeitsmatrix für alle enthaltenen Titel ermittelt, wonach aus dem entsprechenden Konfidenzwerten Playlisten mit ähnlicher Musik erstellt werden können. Zusätzlich können ganze Alben oder Künstlerportfolios an Hand ihrer musikalischen Eigenschaften miteinander verglichen werden.

Das ganze System der inhaltsbasierten Empfehlung ist für den hybriden Einsatz optimiert, d.h. für die Individualisierung von Lösungen können existierende Metadaten oder gesammelte Nutzerdaten (Hörprofile inkl. Titel-IDs) bzw. Daten aus sozialen Netzwerken hinzugefügt und eventuell als Filter benutzt werden.

Außerdem ist es möglich, die komplette Umgebung auf neue Zielgruppen oder Inhaltsgruppen zu trainieren, um z.B. neue oder exotische Genre in bestimmten Regionen oder Produkten besser abzudecken. Dafür wird ein spezielles Training mit Referenz- und Kontrollgruppen der zu verbessernden Inhalte benötigt.

Der Algorithmus ist für alle Betriebssysteme optimiert, ist als Server- und Desktopversion erhältlich und sklalierbar für Archive mit einer 7-stelligen Anzahl an Titeln.

Nutzungspotentiale und Einsatzgebiete

- Musik- und Audio-Archive: automatische Beschreibung von Musik für relevante Suche nach Stichworten (musikalische Merkmale)

- Musikproduktion: automatische Zusammenstellung von ähnlichen Stücken für die Nachvertonung auf Basis inhaltlicher-musikalischer Eigenschaften unter Einbeziehung vorhandener Tags oder Schlagworte (in-Haus Datenbanken)

- Musikprogramme: automatische Erstellung von Playlisten inhaltlich passender Musik als Vorschlag unter Einbeziehung eigener Metadaten (Filter für eigene Genre-Matrix u. ä.)

Referenzprojekte

- Aupeo, Red Bull Mediahouse, Creative Network Design u. a.

Anbieter und Ansprechpartner